المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

اسمحوا لي أن أرسم الصورة.

لنفترض أنك تريد أن يطبخ Humanoid عشاءا لذيذا أثناء جلوسك على الأريكة ومشاهدة Netflix.

كيف سيعمل هذا على المستوى الفني لأن Humanoid يتطلب عدة أدمغة لإعداد عشاءك؟

ذكاء الروبوت ليس متجانسا ، ولكنه فريق من وحدات الذكاء الاصطناعي يجمع بين المداولات البطيئة وردود الفعل السريعة (تصميم النظام 2 + النظام 1).

يقسم نموذج الرؤية واللغة والعمل (VLA) الإدراك إلى وحدة تفكير وسياسة تحكم تفاعلية.

نظرا لأن الروبوت يعمل على بنية معرفية متعددة الأدمغة ، فإنه سيدور مشغل "طاه" مخصصا للتعامل مع طلبك ، مثل مسح المطبخ بكاميراته ، والبحث عن وصفة ، ثم توجيه أطرافه لبدء تقطيع الخضار.

يمكن تقسيم هذه الأدمغة إلى المشغلين التاليين.

الدماغ # 1:

لطهي عشاء لذيذ ، تحتاج إلى مخطط تنفيذي. يفسر أمرك ("تحضير العشاء") لتحديد الهدف (صنع المعكرونة). باستخدام فهم اللغة الطبيعية ، فإنه يقرر المهام الفرعية المطلوبة (العثور على المكونات ، وطهي المعكرونة ، وإعداد الطاولة ، وما إلى ذلك) والأدمغة الأخرى التي يجب أن تتعامل مع كل منها.

ينسق نظام الوكلاء المتعددين: تنشيط الوحدات المتخصصة للرؤية والمعرفة والحركة. يتخذ هذا الدماغ التداولي (النظام 2) قرارات عالية المستوى ، ويحدد النهج ، ويخصص المسؤوليات قبل بدء أي حركات جسدية.

الدماغ # 2:

الآن بعد أن حصلت على الوصفة ، ستحتاج إلى بعض عيون الروبوت والوعي المكاني. يعالج موجزات الكاميرا لتحديد المكونات والأدوات ومواقعها في المطبخ. باستخدام رؤية الكمبيوتر المتقدمة ، يرى لوح التقطيع والخضار في الثلاجة والسكين على المنضدة وما إلى ذلك.

يقوم ببناء خريطة ثلاثية الأبعاد للبيئة وتتبع الكائنات ذات الصلة (مثل مكان وجود الملح أو المقالي). يعمل هذا الدماغ الإدراكي (النظام 2) بشكل أبطأ من ردود الفعل ، ولكنه يوفر سياقا دقيقا للمشهد للتخطيط. من خلال التعرف على جميع القطع المعنية ، فإنه يعلم الروبوت في العالم الحقيقي.

الدماغ # 3:

يعمل هذا الدماغ كقاعدة معرفية وذاكرة للروبوت (النظام 2). يقوم باسترداد وتحليل المعلومات اللازمة للمهمة ، في هذه الحالة ، وصفة مناسبة وتعليمات الطهي. قد يستعلم عن كتاب طبخ عبر الإنترنت أو قاعدة بياناته الداخلية للحصول على وصفة المعكرونة ، ثم يفسر الخطوات (غلي الماء ، وتقطيع الثوم ، وما إلى ذلك).

إنه يتذكر حقائق حول المطبخ (مثل مكان حفظ التوابل) وتجارب الطهي السابقة. بشكل أساسي ، توفير الفهم الدلالي والمعرفة العالمية. ثم يحسب التعليمات المجردة (كراميل البصل) إلى معلمات ملموسة (درجة الحرارة ، التوقيت) التي يمكن للروبوت تنفيذها ، مما يضمن توافق الخطة مع تفضيلاتك.

الدماغ # 4:

مع توضيح الهدف والبيئة ، وضعنا خطة لعب مفصلة. يقسم الهدف عالي المستوى إلى إجراءات مرتبة وخطوات مشروطة. يقوم بجدولة المهام (أحيانا بالتوازي ، مثل تسخين الفرن مسبقا أثناء تقطيع الخضار) ويحدد المعالم (الماء المغلي ، الصلصة جاهزة).

كما أنه يتتبع التقدم ويمكنه إعادة التخطيط بسرعة إذا تغير شيء ما (لنفترض أن أحد المكونات مفقود). ثم يقوم بتسليم تسلسل الحركة هذا إلى أدمغة مستوى الحركة للتنفيذ. نظام آخر 2 الدماغ.

الدماغ # 5:

حان الوقت للانتقال من بنية النظام 2 والانتقال إلى النظام 1 ، وترجمة الخطة إلى حركات روبوت ملموسة. لكل إجراء (مثل "المشي إلى الثلاجة" أو "تقطيع الجزر") ، فإنه يولد مسارات قابلة للتطبيق لجسم الروبوت وأطرافه.

تتعامل هذه الوحدة مع تخطيط المسار والحركية العكسية ، وحساب مسارات وزوايا المفاصل بحيث يتحرك الروبوت بسلاسة دون تصادمات. عادة ما يطبق السياسات الحركية المكتسبة (مثل سياسة محول الانتشار) لإنتاج حركات سائلة للمهام المعقدة.

إذا قال Brain 4 لاسترداد قدر من الثلاجة ، فإن Brain 5 يكتشف كيفية الحصول على الروبوت هناك وكيفية الإمساك بالقدر. حيث ينسق أطرافا متعددة عند الحاجة (باستخدام يدين لرفع قدر ثقيل على سبيل المثال). تتحول النية عالية المستوى إلى تقارب بين الأجهزة والبرامج التي تتحرك أثناء الحركة

الدماغ # 6:

بمجرد تعيين خطة الحركة ، حان وقت التنفيذ. يقود هذا الدماغ المنخفض المستوى للتحكم في النظام 1 مشغلات الروبوت (المحركات والمفاصل). يقرأ باستمرار المستشعرات (زوايا المفاصل والقوة والتوازن) ويرسل إشارات التحكم لمتابعة المسار.

باستخدام حلقات التحكم (وحدات تحكم PID ، والتحكم التنبؤي بالنموذج ، إلخ) للحفاظ على الدقة ، إذا بدأ الروبوت في الانقلاب أو انحرف السكين عن مساره ، فإنه يصحح على الفور. هذه هي ردود الفعل والمهارات الحركية الدقيقة التي تعمل بسرعات مللي ثانية.

عندما يقوم الروبوت بتقطيع جزرة ، يقوم Brain 6 بتعديل القوة وضبط زاوية الشفرة للحصول على شرائح موحدة دون الانزلاق. إنها مثل "ذاكرة العضلات" اللاواعية للنظام ، حيث تتعامل مع التفاصيل منخفضة المستوى تلقائيا.

الدماغ # 7:

القطعة الأخيرة تركز على التحسين المستمر. أثناء وبعد إعداد العشاء ، يحلل الأداء. هل انسبت أي شيء؟ هل كان بطيئا جدا في التحريك؟

تستخدم هذه الوحدة التعلم المعزز والمعايرة الذاتية لتحديث نماذج الروبوت بمرور الوقت. تم تدريب المهارات الأساسية للروبوت في البداية على العروض البشرية الضخمة والتجربة والخطأ ، ولكن عليك أن تقوم بضبطها باستمرار.

إذا اكتشفت تقنية تقطيع أكثر كفاءة أو قبضة ملعقة أفضل ، فإنها تقوم بتحديث سياستها بحيث يصبح العشاء التالي أكثر سلاسة. يسمح هذا الدماغ التكيفي للإنسان بأن يصبح أكثر مهارة في الخبرة.

برنامج الترميز: عوامل التشغيل أثناء العمل

كيف تربط بنية برنامج الترميز هذه العقول معا؟ يعمل كل "دماغ" كوحدة عميل منفصلة في نظام الذكاء الاصطناعي للروبوت. يوفر تنسيق النسيج الخاص ببرنامج الترميز لكل مشغل بيئته الآمنة والمعروضة على الحماية.

بمعنى ، تعمل وحدة الرؤية ، ووحدة اللغة / المنطق ، ووحدة التخطيط ، وما إلى ذلك ، بمعزل عن بعضها البعض مع التواصل من خلال واجهات محددة.

إذا تعطلت إحدى الوحدات أو بها أخطاء ، فلن تسقط الروبوت بأكمله ، ويستمر الآخرون في العمل بأمان. يسهل هذا التصميم المعياري أيضا تحديث أو تبديل دماغ واحد دون التأثير على الباقي ، وإضافة مشغلين متخصصين جدد حسب الحاجة.

يدعم نهج المشغل هذا بشكل مباشر إطار عمل الأدمغة المتعددة. عندما تطلب العشاء ، يمكن للدماغ التنفيذي للروبوت (الدماغ 1) أن يدور مشغل "طاه" مخصص لهذه المهمة ، بينما يتعامل المشغلون الآخرون مع الإدراك والتحكم بالتوازي.

كل مشغل لديه حق الوصول فقط إلى الموارد التي يحتاجها (على سبيل المثال قد يكون لدى وكيل الوصفات إمكانية الوصول إلى الإنترنت لجلب التعليمات ، في حين أن عامل التحكم يتفاعل فقط مع الأجهزة) ، مما يحسن السلامة.

تصميم برنامج الترميز المعياري في وضع الحماية هو الغراء لجميع هذه المهارات المتنوعة التي تعمل معا ، على غرار الخدمات المصغرة في البرامج ، مما يمكن الإنسان من التعامل بشكل موثوق مع المهام المعقدة مثل طهي العشاء من الصفر.

هذا هو السبب في أن $CODEC ستكون البنية التحتية الأساسية للروبوتات.

23 أغسطس 2025

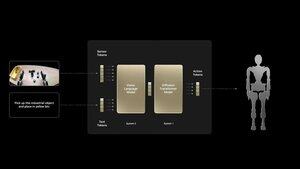

You’ll see foundation models for Humanoids continually using a System 2 + System 1 style architecture which is actually inspired by human cognition.

Most vision-language-action (VLA) models today are built as centralized multimodal systems that handle perception, language, and action within a single network.

Codec’s infrastructure is perfect for this as it treats each Operator as a sandboxed module. Meaning you can spin up multiple Operators in parallel, each running its own model or task, while keeping them encapsulated and coordinated through the same architecture.

Robots and Humanoids in general typically have multiple brains, where one Operator might handle vision processing, another handling balance, another doing high level planning etc, which can all be coordinated through Codec’s system.

Nvidia’s foundation model Issac GR00T N1 uses the two module System 2 + System 1 architecture. System 2 is a vision-language model (a version of PaLM or similar, multimodal) that observes the world through the robot’s cameras and listens to instructions, then makes a high level plan.

System 1 is a diffusion transformer policy that takes that plan and turns it into continuous motions in real time. You can think of System 2 as the deliberative brain and System 1 as the instinctual body controller. System 2 might output something like “move to the red cup, grasp it, then place it on the shelf,” and System 1 will generate the detailed joint trajectories for the legs and arms to execute each step smoothly.

System 1 was trained on tons of trajectory data (including human teleoperated demos and physics simulated data) to master fine motions, while System 2 was built on a transformer with internet pretraining (for semantic understanding).

This separation of reasoning vs. acting is very powerful for NVIDIA. It means GR00T can handle long horizon tasks that require planning (thanks to System 2) and also react instantly to perturbations (thanks to System 1).

If a robot is carrying a tray and someone nudges the tray, System 1 can correct the balance immediately rather than waiting for the slower System 2 to notice.

GR00T N1 was one of the first openly available robotics foundation models, and it quickly gained traction.

Out of the box, it demonstrated skill across many tasks in simulation, it could grasp and move objects with one hand or two, hand items between its hands, and perform multi step chores without any task specific programming. Because it wasn’t tied to a single embodiment, developers showed it working on different robots with minimal adjustments.

This is also true for Helix (Figure’s foundation model) which uses this type of architecture. Helix allows for two robots or multiple skills to operate, Codec could enable a multi agent brain by running several Operators that share information.

This “isolated pod” design means each component can be specialized (just like System 1 vs System 2) and even developed by different teams, yet they can work together.

It’s a one of a kind approach in the sense that Codec is building the deep software stack to support this modular, distributed intelligence, whereas most others only focus on the AI model itself.

Codec also leverages large pre trained models. If you’re building a robot application on it, you might plug in an OpenVLA or a Pi Zero foundation model as part of your Operator. Codec provides the connectors, easy access to camera feeds or robot APIs, so you don’t have to write the low level code to get images from a robot’s camera or to send velocity commands to its motors. It’s all abstracted behind a high level SDK.

One of the reasons I’m so bullish on Codec is exactly what I outlined above. They’re not chasing narratives, the architecture is built to be the glue between foundation models, and it frictionlessly supports multi brain systems, which is critical for humanoid complexity.

Because we’re so early in this trend, it’s worth studying the designs of industry leaders and understanding why they work. Robotics is hard to grasp given the layers across hardware and software, but once you learn to break each section down piece by piece, it becomes far easier to digest.

It might feel like a waste of time now, but this is the same method that gave me a head start during AI szn and why I was early on so many projects. Become disciplined and learn which components can co exist and which components don’t scale.

It’ll pay dividends over the coming months.

Deca Trillions ( $CODEC ) coded.

8.97K

الأفضل

المُتصدِّرة

التطبيقات المفضلة