Populární témata

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

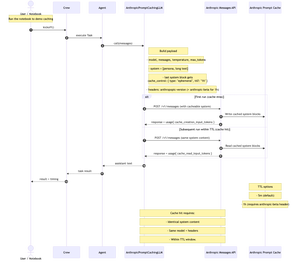

Právě jsem publikoval stručný, podrobný poznámkový blok Jupyter, který ukazuje, jak vytvořit vlastní LLM pro @crewAIInc, který volá rozhraní API Messages API @AnthropicAI a implementuje ukládání výzev do mezipaměti.

Co je to rychlé ukládání do mezipaměti a kdy byste ho měli ve své posádce použít?

Je to způsob, jak ukládat do mezipaměti dlouhou, opakující se část výzvy (obvykle systémový kontext) mezi voláními rozhraní API. odešlete jej jednou, další volání jej znovu použije; Snížení vstupních nákladů o ~90 % a zkrácení doby do prvního tokenu o ~85 % u dlouhých výzev, pokud systémový obsah + model + záhlaví zůstanou stejné a vy jste v rámci TTL (výchozí nastavení 5 m, beta verze 1 h).

To funguje skvěle pro upovídané, víceotáčkové posádky. Užitečné také vždy, když váš tým znovu používá dlouhý, stabilní systémový kontext napříč úkoly (přemýšlejte: příručka, specifikace, souhrn kódové základny). Pokud se váš systém/kontext mění při každém volání, ukládání do mezipaměti vám příliš nepomůže.

kuchařka používá "Frankensteina" z projektu Gutenberg k demonstraci ukládání do mezipaměti se skutečným, dlouhým kontextem.

Níže uvedený diagram: První spuštění zapisuje do mezipaměti; Následná spuštění čtou z mezipaměti, když se systémový obsah, model a hlavičky shodují v rámci hodnoty TTL.

repo + notebook v komentářích.

879

Top

Hodnocení

Oblíbené