熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

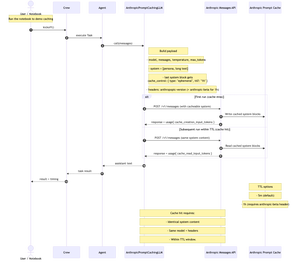

我剛剛發布了一個簡潔的逐步 Jupyter Notebook,展示了如何為 @crewAIInc 構建一個自定義 LLM,該 LLM 調用 @AnthropicAI 的 Messages API 並實現提示緩存。

那麼,什麼是提示緩存,何時在你的團隊中使用它?

這是一種在 API 調用之間緩存提示的長重複部分(通常是系統上下文)的方法。你發送一次,然後後續調用重用它;將輸入成本降低約 90%,並將首次令牌的時間縮短約 85%,前提是系統內容 + 模型 + 頭部保持不變,並且你在 TTL 範圍內(默認 5 分鐘,測試版 1 小時)。

這對於多輪對話的團隊非常有效。任何時候你的團隊在任務之間重用長且穩定的系統上下文時(想想:手冊、規範、代碼庫摘要),也很有用。如果你的系統/上下文在每次調用時都在變化,緩存就不會有太大幫助。

這本食譜使用來自古騰堡計劃的“弗蘭肯斯坦”來演示如何使用真實的長上下文進行緩存。

下面的圖示:第一次運行寫入緩存;後續運行在系統內容、模型和頭部在 TTL 範圍內匹配時從緩存讀取。

代碼庫 + Notebook 在評論中。

889

熱門

排行

收藏