Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

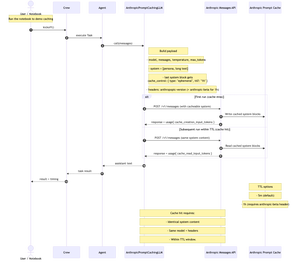

Я щойно опублікував стислий, покроковий блокнот Jupyter, який показує, як створити кастомний LLM для @crewAIInc, який викликає API Messages @AnthropicAI та реалізує оперативне кешування.

Що ж таке оперативне кешування і коли його варто використовувати у своїй команді?

Це спосіб кешувати довгу, повторювану частину вашого запиту (зазвичай системний контекст) між викликами API. ви надсилаєте його один раз, а потім наступні дзвінки використовують його повторно; Зниження вхідних витрат на ~90% і прискорення часу до першого токена на ~85% для довгих підказок, за умови, що системний контент + модель + заголовки залишаються незмінними і ви перебуваєте в межах TTL (5 млн за замовчуванням, 1 год бета).

Це чудово підходить для балакучих екіпажів з кількома ходами. Це корисно щоразу, коли ваша команда повторно використовує довгий, стабільний системний контекст для виконання завдань (наприклад: довідник, специфікація, зведення кодової бази). Якщо ваша система/контекст змінюється кожного виклику, кешування не дуже допоможе.

у кулінарній книзі використовується «Франкенштейн» з проекту «Гутенберг», щоб продемонструвати кешування з реальним, довгим контекстом.

Діаграма нижче: перший запуск записує в кеш; подальші запуски зчитуються з кешу, коли системний контент, модель і заголовки збігаються в межах TTL.

РЕПО + Блокнот у коментарях.

894

Найкращі

Рейтинг

Вибране