Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

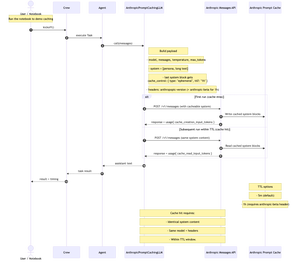

Jag har precis publicerat en kortfattad, steg-för-steg Jupyter Notebook som visar hur man bygger en anpassad LLM för @crewAIInc som anropar @AnthropicAI:s Messages API och implementerar snabb cachelagring.

Tja, vad är Prompt Caching och när ska du använda det i din besättning?

Det är ett sätt att cachelagra den långa, upprepade delen av din prompt (vanligtvis systemkontext) mellan API-anrop. du skickar den en gång och sedan återanvänder efterföljande anrop den; minska inmatningskostnaden med ~90 % och påskynda tiden till första token med ~85 % för långa uppmaningar, så länge systeminnehållet + modellen + rubrikerna förblir detsamma och du är inom TTL (5 m standard, 1 timme beta).

Detta fungerar utmärkt för pratsamma besättningar med flera varv. Det är också användbart när ditt arbetslag återanvänder ett långt, stabilt system för olika uppgifter (t.ex. handbok, specifikation, sammanfattning av kodbas). Om ditt system/sammanhang ändras varje anrop kommer cachelagring inte att hjälpa mycket.

Kokboken använder "Frankenstein" från Project Gutenberg för att demonstrera cachning med verkligt, långt sammanhang.

diagram nedan: skrivningar till cache för första körningen; efterföljande körningar läses från cacheminnet när systeminnehåll, modell och rubriker matchar inom TTL.

Lagringsplats + notebook-fil i kommentarer.

922

Topp

Rankning

Favoriter