Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

acabo de publicar un cuaderno de Jupyter conciso y paso a paso que muestra cómo construir un LLM personalizado para @crewAIInc que llama a la API de Mensajes de @AnthropicAI e implementa el almacenamiento en caché de prompts.

bueno, ¿qué es el almacenamiento en caché de prompts y cuándo deberías usarlo en tu equipo?

es una forma de almacenar en caché la parte larga y repetida de tu prompt (generalmente el contexto del sistema) entre llamadas a la API. lo envías una vez, luego las llamadas subsiguientes lo reutilizan; reduciendo el costo de entrada en un ~90% y acelerando el tiempo hasta el primer token en un ~85% para prompts largos, siempre que el contenido del sistema + modelo + encabezados permanezcan iguales y estés dentro del TTL (5m por defecto, 1h en beta).

esto funciona muy bien para equipos conversadores y de múltiples turnos. también es útil cada vez que tu equipo reutiliza un contexto del sistema largo y estable a través de tareas (piensa: manual, especificación, resumen de código). si tu sistema/contexto cambia en cada llamada, el almacenamiento en caché no ayudará mucho.

el libro de cocina utiliza “Frankenstein” de Project Gutenberg para demostrar el almacenamiento en caché con un contexto real y largo.

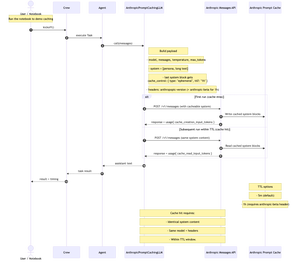

diagrama a continuación: la primera ejecución escribe en la caché; las ejecuciones subsiguientes leen de la caché cuando el contenido del sistema, modelo y encabezados coinciden dentro del TTL.

repositorio + cuaderno en los comentarios.

893

Parte superior

Clasificación

Favoritos