Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

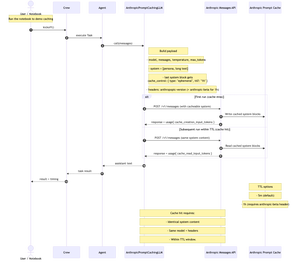

Je viens de publier un carnet Jupyter concis et étape par étape montrant comment construire un LLM personnalisé pour @crewAIInc qui appelle l'API Messages de @AnthropicAI et implémente la mise en cache des prompts.

Alors, qu'est-ce que la mise en cache des prompts et quand devriez-vous l'utiliser dans votre équipe ?

C'est un moyen de mettre en cache la partie longue et répétée de votre prompt (généralement le contexte système) entre les appels API. Vous l'envoyez une fois, puis les appels suivants le réutilisent ; réduisant le coût d'entrée d'environ 90 % et accélérant le temps jusqu'au premier jeton d'environ 85 % pour les longs prompts, tant que le contenu système + le modèle + les en-têtes restent les mêmes et que vous êtes dans le TTL (5 minutes par défaut, 1 heure en bêta).

Cela fonctionne très bien pour les équipes bavardes et multi-tours. Également utile chaque fois que votre équipe réutilise un long contexte système stable à travers les tâches (pensez : manuel, spécification, résumé de code). Si votre système/contexte change à chaque appel, la mise en cache ne sera pas très utile.

Le livre de recettes utilise "Frankenstein" de Project Gutenberg pour démontrer la mise en cache avec un vrai long contexte.

Diagramme ci-dessous : la première exécution écrit dans le cache ; les exécutions suivantes lisent à partir du cache lorsque le contenu système, le modèle et les en-têtes correspondent dans le TTL.

Dépôt + carnet dans les commentaires.

892

Meilleurs

Classement

Favoris