Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

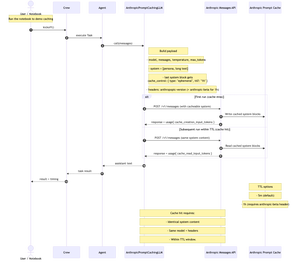

Właśnie opublikowałem zwięzły, krok po kroku notatnik Jupyter, który pokazuje, jak zbudować niestandardowy LLM dla @crewAIInc, który wywołuje API wiadomości @AnthropicAI i implementuje pamięć podręczną zapytań.

Cóż, czym jest pamięć podręczna zapytań i kiedy powinieneś jej używać w swoim zespole?

To sposób na przechowywanie długiej, powtarzającej się części twojego zapytania (zwykle kontekstu systemowego) między wywołaniami API. Wysyłasz to raz, a następne wywołania ponownie to wykorzystują; obniżając koszty wejścia o ~90% i przyspieszając czas do pierwszego tokena o ~85% dla długich zapytań, pod warunkiem, że zawartość systemu + model + nagłówki pozostają takie same i jesteś w ramach TTL (domyślnie 5 minut, beta 1 godzina).

To świetnie działa dla rozmownych, wieloetapowych zespołów. Również przydatne za każdym razem, gdy twój zespół ponownie wykorzystuje długi, stabilny kontekst systemowy w różnych zadaniach (pomyśl: podręcznik, specyfikacja, podsumowanie bazy kodu). Jeśli twój system/kontekst zmienia się przy każdym wywołaniu, pamięć podręczna nie pomoże zbytnio.

Książka kucharska wykorzystuje "Frankenstein" z Projektu Gutenberg, aby zademonstrować pamięć podręczną z rzeczywistym, długim kontekstem.

Diagram poniżej: pierwsze uruchomienie zapisuje do pamięci podręcznej; kolejne uruchomienia odczytują z pamięci podręcznej, gdy zawartość systemu, model i nagłówki pasują w ramach TTL.

Repozytorium + notatnik w komentarzach.

891

Najlepsze

Ranking

Ulubione