Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

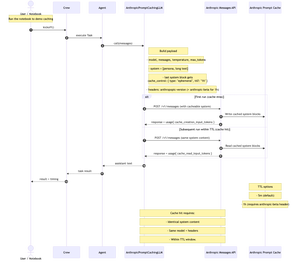

Acabei de publicar um Jupyter Notebook conciso e passo a passo mostrando como criar um LLM personalizado para @crewAIInc que chama a API de mensagens do @AnthropicAI e implementa o cache de prompt.

Bem, o que é cache imediato e quando você deve usá-lo em sua equipe?

É uma maneira de armazenar em cache a parte longa e repetida do prompt (geralmente o contexto do sistema) entre as chamadas de API. você o envia uma vez e, em seguida, as chamadas subsequentes o reutilizam; Reduzindo o custo de entrada em ~90% e acelerando o tempo para o primeiro token em ~85% para prompts longos, desde que o conteúdo do sistema + modelo + cabeçalhos permaneçam os mesmos e você esteja dentro do TTL (padrão de 5M, 1h beta).

Isso funciona muito bem para tripulações tagarelas e com vários turnos. Também é útil sempre que sua equipe reutiliza um contexto de sistema longo e estável em todas as tarefas (pense: manual, especificação, resumo da base de código). Se o seu sistema/contexto mudar a cada chamada, o cache não ajudará muito.

o livro de receitas usa "Frankenstein" do Projeto Gutenberg para demonstrar o cache com contexto real e longo.

Diagrama abaixo: Primeiro execute gravações no cache; as execuções subsequentes são lidas do cache quando o conteúdo, o modelo e os cabeçalhos do sistema correspondem ao TTL.

repositório + notebook nos comentários.

897

Melhores

Classificação

Favoritos