Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

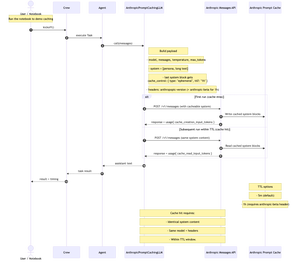

Ich habe gerade ein prägnantes, schrittweises Jupyter-Notebook veröffentlicht, das zeigt, wie man ein benutzerdefiniertes LLM für @crewAIInc erstellt, das die Messages API von @AnthropicAI aufruft und Prompt-Caching implementiert.

Was ist also Prompt-Caching und wann solltest du es in deinem Team verwenden?

Es ist eine Möglichkeit, den langen, wiederholten Teil deines Prompts (normalerweise Systemkontext) zwischen API-Aufrufen zu cachen. Du sendest es einmal, dann verwenden nachfolgende Aufrufe es wieder; das senkt die Eingabekosten um ~90% und beschleunigt die Zeit bis zum ersten Token um ~85% für lange Prompts, solange der Systeminhalt + Modell + Header gleich bleiben und du innerhalb der TTL (5 Minuten Standard, 1 Stunde Beta) bist.

Das funktioniert großartig für gesprächige, mehrteilige Teams. Auch nützlich, wenn dein Team einen langen, stabilen Systemkontext über Aufgaben hinweg wiederverwendet (denk an: Handbuch, Spezifikation, Zusammenfassung des Codebases). Wenn sich dein System/Kontext bei jedem Aufruf ändert, wird Caching nicht viel helfen.

Das Kochbuch verwendet "Frankenstein" von Project Gutenberg, um das Caching mit echtem, langem Kontext zu demonstrieren.

Diagramm unten: Der erste Lauf schreibt in den Cache; nachfolgende Läufe lesen aus dem Cache, wenn Systeminhalt, Modell und Header innerhalb der TTL übereinstimmen.

Repo + Notebook in den Kommentaren.

887

Top

Ranking

Favoriten